賢いカメラに未来あり。

気まぐれから始まったデジタルカメラ時代は、これまでに人工衛星、手持ちカメラ、胃カメラというように様々な進化を遂げてきました。もうそろそろ限界かなー、と思いきや、どうやらそのフルポテンシャルはまだまだ先。

次なる進化は「加工力」のようです。

通常、カメラの性能の話をするときはセンサーサイズやレンズの明るさなどのスペックが槍玉に上がりますが、これからはカメラどれほど気が利くかが大事になるでしょう。その根幹にある「コンピュテーショナル・フォトグラフィー」という技術は、いまは主にスマホカメラを語るときに使われていますます。Googleに続きAppleも2018年の9月に使い始めた言葉なので、2019年は「ノッチ」並に連発されるのは必至!

スマホカメラだけでなくこれからのデジカメすべてに影響を与え始めているコンピュテーショナル・フォトグラフィー。写真撮りなら無視できないカメラの最先端を、スパスパとご紹介していきますよー。

クオリティーは枚数で稼ぐ:Pixel 3

コンピュテーショナル・フォトグラフィーを知る上で欠かせないのが、HDRという技術です。これは、露出の異なる(明るい&暗い)写真を組み合わせることで、明暗が激しいシーンも黒つぶれ・白飛びさせず写せるというもの。

Pixel 3のカメラにも低露出の(暗い)写真を組み合わせて露出を積み重ねる「HDR+」という技術が埋め込まれていて、通常のとはちょっと違いますが、狙いどころは大体同じですね。またPixelにはもうひとつ「夜景モード」という機能があります。これはHDR+をさらに強化したような機能で、組み合わせる写真を増やしたり、組み合わせる写真の露出・露光時間を上げるなどで暗所撮影を得意としています。

ではまず、3枚の写真をご覧ください。どれもPixel 3で撮影したものですが、撮影モードを「HDR+オフ」「HDR+オン」「夜景モードオン」の順に切り替えています。

いやぁ、まったく比べ物になりません。HDR+がオフの1枚目はノイズが目立ちますし、HDR+オンの2枚目はノイズが激減したものの明るさと色にズレが発生。でも「夜景モード」の3枚目の写真は、ノイズもなければ明るさも色もかなりいい感じです。

こんな風に、撮影モードを切り替えるだけでここまで差が出るという事実こそが、コンピュテーショナル・フォトグラフィーの真髄になります。ハードウェアが同じでも、ソフトウェアが違えば撮れる画も違う。アプリなどのソフトウェアを走らせていたスマホが、その苗床となっているのも納得です。

精巧なウソ:ポートレートモード

スマホのポートレートモードは、本当に被写界深度をコントロールして撮影しているわけではありません。視差とAIを駆使して被写体を認識し、数学でその他をボケさせるという、手間隙かかったウソなんです。

そこまでしてボカーを追い求めるのはユーザーが求めるからですが、それを可能にするのは2つの視点と頭脳がスマホに備わったから。下の画像はPixel 2のデュアルピクセルセンサーが見る「視差」になります。

写真全体が上下しているなか、背景のほうがちょっとだけズレ度が大きいですよね。この僅かな差から深度マップというものを作成し、焦点を合わせた距離のもの以外をボケさせる。…というわけなんですが、このボケ処理がソフトウェアで施されるからこそできる、コンピューテーショナル・フォトグラフィーならではの芸当があります。

前後に距離がある2人の顔をクッキリ写しながらも、背景をボケさせるというこの妙技。ただ深度マップに従ってボケ処理をしていたらこうはなりません。しかし機械学習を駆使して人の顔を認識し、人物のみを切り取って焦点を合わせることによって実現できてしまうんです。通常のカメラだったら二枚の写真を撮って合成するなどしないとできませんが、コンピュテーショナル・フォトグラフィーに特化したデバイスなら一瞬!

ちなみにこの技術を応用すれば、異なった距離にある被写体ごとに、個別でホワイトバランスを合わせるなどの機能も可能だそう。深度マップという武器を手にしたカメラの今後が楽しみですね。

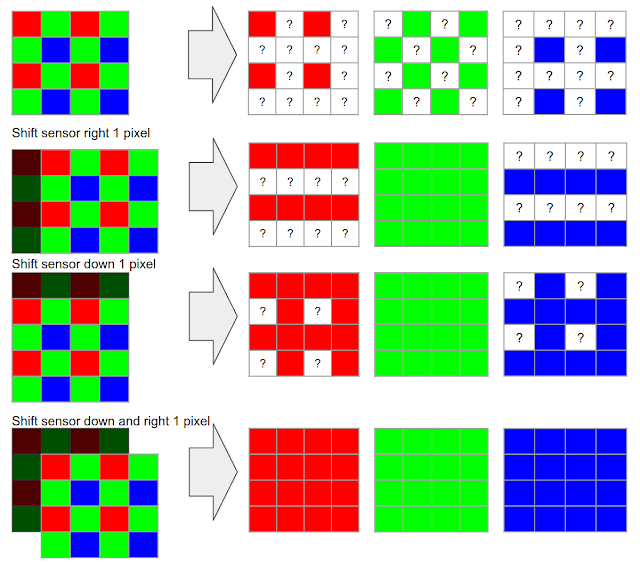

天文学から応用:超解像ズーム

従来、スマホカメラのズームはデジタルズームだけでした。これは撮った写真をあとから拡大するのと変わらないやり方なので、画質は劣化するばかり。でも最近は一方がズームレンズの二眼スマホが増えたので、搭載機種は光学ズームも可能になりましたよね。でも、Pixel 3はそのどちらでもない方法でズームします。その名も「超解像ズーム」。

理屈はシンプルで、撮影時の手ブレを活用してセンサーサイズと画素数を擬似的にアップするというもの。下の画像のように、1ピクセルずつズレた画像を組み合わせることによって、解像度が仮想的に約4倍にできちゃう技術です。

現在は1.2倍以上にズームしているときにしか発動しないそうですが、それは「処理パフォーマンスが限られている」からだそうで、未来のPixelは常時発動できそうな雰囲気を醸し出しています。このズレ活用技術とHDR+を応用したPixel 3のRAWモードは、なんとAPS-Cセンサーと同等の出力が可能だそう。

「撮影モード」がいらなくなる:AIカメラ

これまで撮影モードのスゴさを伝えておいて「いらなくなる」とはどういう了見だ!なんていうお声もあるかと思いますが、もうすでにそうなりつつありまして…。たとえばGalaxy Note 9やHuawei Mate 20などがよい例で、AIが被写体や環境を認識してカメラの調節を勝手にしてくれるんです。もうワンタップでいいんですよ、われわれ人間のすることといったら。

だから被写体が動植物・料理・人だったらそれに合わせてくれますし、明るい・暗い・逆光などの環境にも勝手に対応してくれます。それどころか「被写体ごとの調節」も可能になるでしょう。Pixelはすでに、人物に対して「合成デーライトシンクロ」を発動していて、これは人物を認識したら背景から切り出したあとに、ぼんやり明るく処理する「仮想的なフラッシュ」だそうです。

そんなこんなで、いわゆる「撮影モード」は「マニュアルモードのひとつ」となり、通常はAIがその時々の被写体や環境に合わせて細かく自己調節してくれるはず。いやぁ、至れり尽くせりです。

「脳」あるカメラに未来あり

これからのカメラはセンサーやレンズではなく、その賢さやプロセッサパワーに肝がありそうです。いまフルサイズミラーレスがデジカメ界を塗り替えているように、近い未来「コンピュテーショナル・コンデジ」が生まれることを楽しみにしています。ほら、著名カメラレビューサイトも「受け入れよう」と言っていますから。

カメラメーカーさん、なにとぞ!

Source: Google (1, 2, 3, 4, 5), YouTube (1, 2, 3, 4, 5), The Verge, DPReview (1, 2, 3)