昨年から、AIアート生成ツールが急速に増えてきたことを皆さん実感しているはず。

これらは非常にスマートで、本物の写真や人間によって作成されたアートワークそっくりの画像を生成することができます。

これらのツールは日々パワーアップしており、多くの機能が追加されています。Microsoftの「ペイント」ツールにも、AIアートツールが追加されたほど。

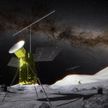

そして、月額20ドル(約3,200円)で利用できるChatGPT Plusでは、DALL-E AI画像モデルの新しい機能が利用可能となりました。これは、Photoshopで行なうような画像の一部だけを編集する「部分編集」機能です。今回はその機能について詳しく解説します。

ChatGPT Plusの新機能とは?

この新機能を使えば、画像の1つの要素を変更したいときでも、完全に新しい画像を再生成する必要はありません。画像の調整したい部分を指定し、DALL-Eに指示をするだけ。もちろん、画像のほかの部分はそのままで保存が可能です。

これにより、AIアートの制約の1つである、同じプロンプトを使用していても、ユニークでまったく異なる画像や動画が出力される場合がある、という課題を克服できます。

しかし、拡散モデルと呼ばれるものに基づくこれらのAIアート生成ツールには、画像間での一貫性を実現したり、アイデアを微調整したりといった、克服すべき課題が多く存在するのも事実です。

ChatGPTで画像を編集する方法

ChatGPT Plusのユーザーであれば、ウェブやモバイルでアプリを起動し、何でも好きなものの画像をリクエストすることができます。

たとえば、「サイバーパンクの舞台で事件を解決する漫画の犬の刑事」や「遠くに孤独な人の姿が見える丘の連なり、頭上には嵐雲が立ち込める風景」など、何でもOK。数秒後に、画像が出力されます。

その画像を編集するには、生成された画像をクリックし、右上隅にある「選択」ボタン(ペンで線を書いたようなアイコン)をクリックします。

次に、左上隅にあるスライダーを使用して、選択ツールのサイズを調整し、画像の変更したい部分を選択します。

これこそが大きく進化した点で、画像の一部をそのままで、選択した部分だけを編集することができるのです(以前は、特定の部分を変更するような追加のプロンプトを送信した場合、画像全体が再生成され、元の画像とはかなり異なったものが出力されました)。

編集したい部分の選択が完了すると、強調して表示された画像の部分に対して新しい指示を入力するよう促されます。これらのAIアート生成ツールでは、できるだけ具体的に指示を出すほど良い結果が得られます。

たとえば、「人物をもっと幸せに見えるように(またはもっと幸せでないように)見せてほしい」とか「建物の色を変更してほしい」と要求するとします。そうすると、あなたのリクエストした変更が適用されます。

私の実験によると、ChatGPTとDALL-Eは、GoogleのMagic Eraserなどのアプリで見られるような同じ種類のAIトリックを展開しているようです。シーン内の既存の情報に基づいて背景を知能的に補完し、選択範囲の外側のすべてをそのまま残すようにするのです。

なお、選択ツールとして高度な部類ではありません。また、境界やオブジェクトのエッジに不一致が見られる場合も。

多くの場合、編集機能は十分に機能しましたが、毎回信頼できる出力ではありませんでした。これは、疑いなくOpenAIが将来改善を目指すべき点でしょう。

使って感じた、AIアートの課題

新しい編集ツールを使ってさまざまなトリックを試してみました。

犬を牧草地に置いて色や位置を変更することはうまくいきましたが、城壁の上に立つ巨人のサイズを縮小することはあまりうまくいきませんでした。巨人は、城壁の部品のぼやけた中で消えてしまいました。これは、AIが巨人の周りをうまく塗りつぶそうとしていたものの、うまくいかなかったことを示しています。

「サイバーパンクの舞台で車を追加」するように要求しましたが、車は表示されませんでした。別の城のシーンでは、飛んでいる竜を反対方向に向くよう向きを変え、竜の色を緑から赤に変更し、口から炎を出すように要求しました。数秒後、ChatGPTは竜を完全に取り除きました。

この機能はまだ新しく、OpenAIはまだ人間の画像編集に取って代われるとは主張していません。なぜなら、明らかにそれはできないからです。

とはいえ、今後この機能は改善されていくでしょう。私が紹介したような間違いは、特定の種類のAIが生成するアートにはどんな課題が発生しやすいのかを見つけるのに役立ちます。

DALL-Eやそのようなモデルが非常に得意とするのは、訓練された何百万という数の城のデータに基づいて、良い近似値を提供するためのピクセルの配置を知っていることです。

しかし、AIは幾何学や物理空間を理解していないため、城が何なのかを知りません。私がAIにつくらせた城には、どこからともなく砲台が突き出しています。建物や家具、または適切にレンダリングされていないオブジェクトを含む多くのAI生成アートに、このような課題が見られます。

このような課題の根本にあるのは、これらのAIモデルは「何を表示しているのか」をまだ理解していないということ。

これが、OpenAI Soraの多くの動画で人がどこかに消える理由です。AIは非常に巧みにピクセルを配置しているのであって、人を追跡しているわけではないのです。

AIは異なる人種のカップルの画像を生成するのに苦労するという記事を読んだことがあるかもしれません。これは画像トレーニングデータに基づくと、同じ人種のカップルは、異なる人種のカップルと比べより一般的であるためです。

最近注目されているもう1つの興味深い点は、これらのAIアート生成ツールが白い背景を作成できないということです。

AIアート生成ツールは多くの面で非常に賢いツールですが、私たちが思考する方法や人間のアーティストが理解する方法とは異なり、「考えている」わけではありません。

そのため、AIアート生成ツールを使用する際にはこの点を考慮することが重要です。

Appleの新しいAI画像編集ツール「MGIE」とは? | ライフハッカー・ジャパン https://www.lifehacker.jp/article/2402-apple-has-a-new-open-source-ai-image-editor/

ChatGPTは要約の鬼! 大量の情報から一瞬でデータを抽出するコツ | ライフハッカー・ジャパン https://www.lifehacker.jp/article/2404-ai-case/

「計算系の」地味に面倒なタスクこそAIで解決!ChatGPTやGeminiでかなり時短できる実例3つ | ライフハッカー・ジャパン https://www.lifehacker.jp/article/2404_computational_tasks_are_what_ai_solves/

Source: X, Wikipedia, The Verge, PetaPixel

![ライフハッカー[日本版]](https://img.topics.smt.news.goo.ne.jp/img/ip_logo/lifehacker_d.gif?150x0)

![[連載]イーストスタッドブログ・第7回 新種牡馬、レッドルゼルについて](https://img.topics.smt.news.goo.ne.jp/image_proxy/smartcrop/w_202_h_152_q_80/picture/umafuri/s_umafuri-33395.jpg)